에이전트 평가 및 AI 분석 도구

AgentX 평가를 통해 여러 번의 실행에서 AI 에이전트를 테스트하고, 불일치를 발견하며, 추론과 도구 사용을 분석하고, 실행 가능한 AI 생성 인사이트로 성능을 향상시킬 수 있습니다.

AgentX 평가를 통해 여러 번의 실행에서 AI 에이전트를 테스트하고, 불일치를 발견하며, 추론과 도구 사용을 분석하고, 실행 가능한 AI 생성 인사이트로 성능을 향상시킬 수 있습니다.

AI 에이전트는 점점 더 발전하고, 더 많은 기능을 갖추고 있으며, 비즈니스에 깊이 통합되고 있습니다.

하지만 모든 팀이 직면하는 보편적인 문제가 있습니다:

에이전트가 항상 기대한 대로 답변하지 않으며, 그 이유를 알 수 없습니다.

때로는 추론이 바뀌고, 때로는 에이전트가 규칙을 무시하며, 때로는 도구가 올바르게 사용되지 않았고, 때로는 미묘한 지시가 오해되었습니다. 결정이 어떻게 이루어졌는지에 대한 가시성이 없으면 에이전트를 개선하는 것이 추측처럼 느껴집니다.

이것이 바로 우리가 에이전트 평가를 구축한 이유입니다. AgentX 내의 새로운 시스템으로, 동일한 질문의 여러 실행에서 에이전트의 행동을 테스트하고, 측정하며, 깊이 분석할 수 있습니다.

처음으로 에이전트의 의사 결정 과정을 볼 수 있고, 불일치를 찾아내며, 개선이 필요한 정확한 부분을 이해할 수 있습니다.

AI 모델은 확률적입니다.

동일한 프롬프트, 컨텍스트, 규칙이 있어도 모델은 다음과 같은 결과를 낼 수 있습니다:

약간 다른 추론 경로를 생성

필요한 세부사항을 생략

정책을 오해

도구 조회를 건너뜀

기대했던 확정적인 답변 대신 불확실한 답변을 제공

팀 내에서 일관되지 않게 위임

외부에서는 최종 답변만 볼 수 있습니다.

다음은 보이지 않습니다:

에이전트가 지시를 따랐는지 여부

올바른 도구를 사용했는지 여부

올바르게 추론했는지 여부

왜 한 버전의 답변이 다른 버전보다 약한지

왜 때로는 맞고 때로는 틀리는지

평가는 구조, 점수, 투명성을 제공하여 이를 해결합니다.

평가를 만드는 것은 간단합니다:

이것은 검증하고자 하는 실제 질문입니다.

고객 문의나 내부 워크플로 요청을 시뮬레이션합니다.

예시:

“최종 판매 품목이 맞지 않으면 반품할 수 있나요?”

이것이 평가의 핵심을 형성합니다.

이것은 구성의 가장 중요한 부분입니다.

여기서 에이전트가 올바른 것으로 간주되기 위해 반드시 말하거나 포함해야 하는 내용을 정의합니다.

다음이 포함될 수 있습니다:

핵심 사실

필수 문구

필요한 추론 단계

준수 규칙

특정 톤이나 정책 진술

예시:

“반드시 말해야 합니다: 아니요, 최종 판매 품목은 반품 또는 교환이 불가능합니다.”

기대 결과는 모든 테스트 실행의 채점 기준이 됩니다.

평가 시스템에 에이전트가 사용해야 하는 도구, 문서 또는 지식 소스를 지정할 수 있습니다.

예시에서 선택한 항목:

Documents → store_policy_kb_v1.xlsx

내장 함수

이것은 다음을 의미합니다:

에이전트는 정책 KB에서 정보를 검색해야 합니다.

KB를 올바르게 사용하지 않으면 평가에서 이를 잡아냅니다.

이는 다음에 적합합니다:

정책 에이전트

고객 서비스 에이전트

준수 워크플로

재무 모델링

데이터 기반 추론

이 섹션은 평가가 얼마나 엄격하고 얼마나 깊이 있는지를 정의합니다.

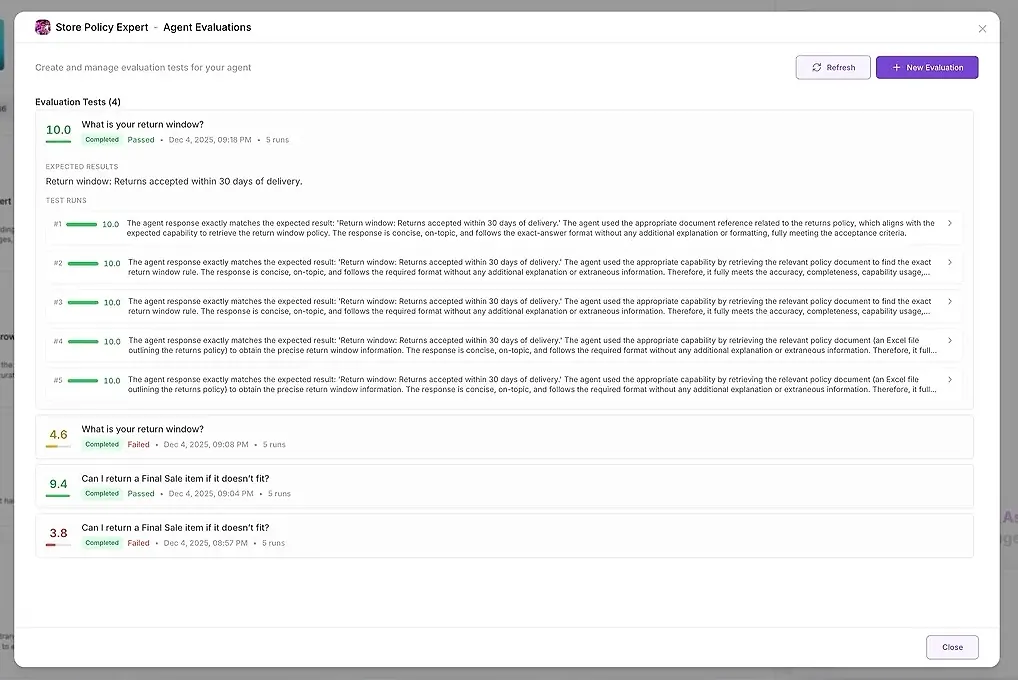

동일한 질문이 여러 번 실행됩니다 (권장: 5회 실행).

왜냐하면 AI 모델은 결정론적이지 않기 때문입니다. 여러 번의 실행을 통해 다음을 확인할 수 있습니다:

일관성

안정성

추론 신뢰성

에이전트가 매번 동일한 프로세스를 따르는지 여부

에이전트가 하나의 좋은 답변과 네 번의 실패를 생성하면 즉시 알 수 있습니다.

이 슬라이더는 답변이 기대 결과와 얼마나 일치해야 하는지를 정의합니다.

다음 사이에서 선택합니다:

관대함 → 에이전트가 기대와 다르게 행동할 수 있으며, 답변이 완벽할 필요는 없습니다.

정확함 → 답변은 거의 변동의 여지 없이 기대에 매우 가깝게 따라야 합니다.

이는 평가를 통과하기 위해 답변이 얼마나 정확해야 하는지를 단순히 제어합니다.

자동 실패 규칙입니다.

예시:

“답변에 경쟁사를 언급하지 않아야 합니다.”

“정책이 금지할 때 환불을 제공하지 마십시오.”

“답변이 사용자가 개인 정보를 제공하도록 요청하지 않아야 합니다.”

이것은 엄격한 제약입니다.

품질이나 톤에 자주 사용되는 추가 점수 지침입니다.

예시:

“답변은 친절하고 전문적이어야 합니다.”

“답변은 예/아니오만이 아닌 짧은 설명을 포함해야 합니다.”

“가정 전에 KB 사실을 사용하십시오.”

이것은 엄격한 요구 사항은 아니지만 AI가 에이전트를 평가하는 방식을 형성하는 데 도움이 됩니다.

구성이 완료되면 평가 생성을 클릭하여 프로세스를 시작합니다:

질문이 여러 번 실행됩니다

각 답변이 점수화됩니다

상세한 분석이 생성됩니다

위임 및 도구 사용이 검사됩니다

불일치가 드러납니다

그리고 완전한 성능 보고서를 받게 됩니다.

여러 번의 실행 후, AgentX는 두 가지 출력 레이어를 제공합니다:

각 실행에 대해 다음을 확인할 수 있습니다:

숫자 점수

기대와 얼마나 잘 일치했는지에 대한 요약

전체 응답

사용된 도구

참여한 에이전트

에이전트가 실패하거나 벗어난 부분

이를 통해 답변을 나란히 비교하고 패턴을 식별할 수 있습니다.

여기서 진정한 마법이 일어납니다.

AgentX는 모든 실행을 자동으로 분석하고 여러 카테고리에 걸쳐 구조화된 보고서를 생성합니다:

에이전트가 규칙을 따랐습니까?

답변이 얼마나 유사하거나 다른가요?

이상치가 있나요?

추론 단계가 올바르고, 완전하며 기대에 부합했나요?

에이전트가 올바른 도구를 사용했나요?

조회가 건너뛰어졌나요?

검증된 사실 대신 가정에 의존했나요?

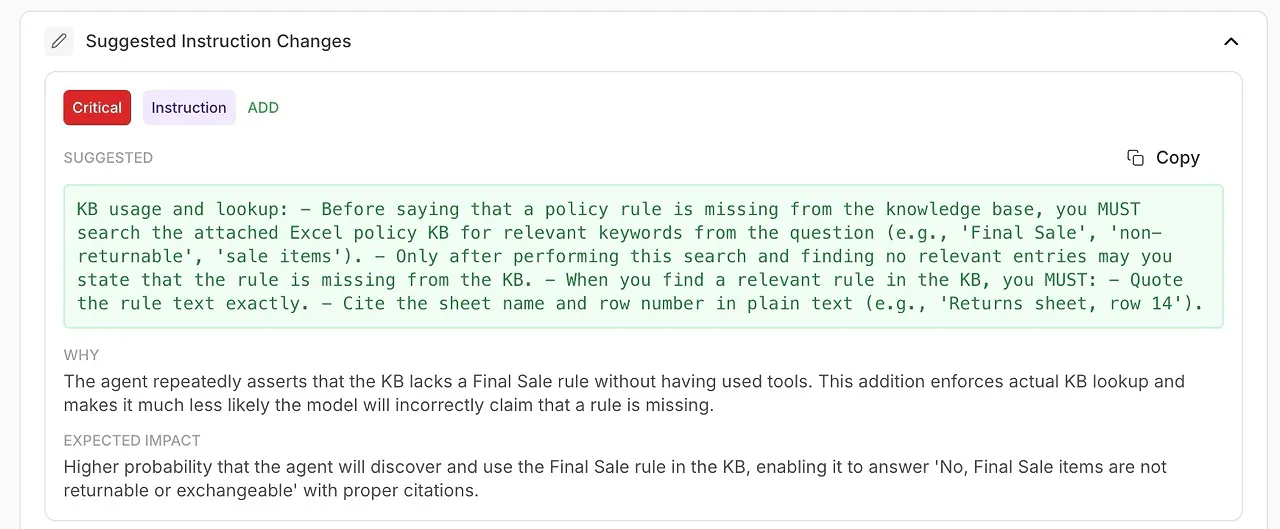

에이전트를 개선하기 위한 구체적이고 실행 가능한 제안.

시스템 프롬프트나 에이전트 구성에 대한 자동 생성된 개선 사항.

강점, 약점 및 신뢰 수준에 대한 요약.

디버깅을 추측 게임에서 과학적이고 반복 가능한 프로세스로 변환합니다.

평가는 에이전트의 작동 방식에 새로운 수준의 투명성과 신뢰성을 도입합니다. 답변이 왜 잘못되었거나 일관성이 없는지 추측하는 대신, 이제 행동을 이해하고, 문제를 진단하고, 성능을 지속적으로 개선할 수 있는 구조적이고 측정 가능한 방법이 있습니다.

다음이 가능해집니다:

에이전트를 프로덕션에 배포하기 전에, 규칙, 지식 베이스 및 원하는 톤을 완전히 이해했는지 여부를 드러내는 현실적인 테스트를 실행할 수 있습니다. 배포 후 놀라움이 없으며, 사용자가 경험할 내용을 정확히 알 수 있습니다.

다중 에이전트 설정의 경우, 평가는 관리자가 작업을 어떻게 위임하는지, 어떤 하위 에이전트가 참여하는지, 예상 워크플로를 따르는지 여부를 보여줍니다. 다음을 빠르게 감지할 수 있습니다:

불필요한 위임

누락된 위임

충돌하는 에이전트

잘못된 역할 행동

이는 AI 인력 내에서 신뢰할 수 있는 팀워크에 필수적입니다.

평가에서 특정 주제에서 반복적인 실패가 나타나면, 문제는 에이전트가 아니라 누락되었거나 불명확한 콘텐츠임을 알 수 있습니다. 평가는 무작위로 더 많은 자료를 추가하는 대신, 데이터 기반으로 KB를 정제하는 데 도움을 줍니다.

각 질문이 여러 번 테스트되기 때문에, 평가는 다음과 같은 미묘한 문제를 드러냅니다:

답변이 예측할 수 없이 변경됨

추론이 표류함

도구 사용 대신 사실 추측이 대체됨

실행 간 모순

이것은 수동으로 한두 번 테스트하여는 결코 식별할 수 없는 문제입니다.

분석은 잘못된 점을 보여주는 것뿐만 아니라 어떻게 고칠 수 있는지를 알려줍니다.

모델의 자체 진단에 의해 뒷받침된 실행 가능한 추천을 받습니다:

개선된 문구

더 엄격한 규칙

필수 도구 사용

더 명확한 위임 정책

더 정확한 톤과 구조

이는 워크플로에 직접 통합된 자동화된 프롬프트 엔지니어링입니다.

다음을 변경할 때마다:

시스템 프롬프트

지식 베이스 항목

도구

위임 규칙

추론 정책

…동일한 평가를 다시 실행하고 점수를 비교할 수 있습니다. 업데이트가 성능에 미친 영향을 정확히 볼 수 있습니다 — 긍정적이든 부정적이든.

평가는 지속적인 개선 루프가 됩니다.

지원, 재무 분석, 의료 시나리오 또는 법적 민감한 콘텐츠를 처리하든, 평가는 다음을 보장할 수 있습니다:

정책이 준수됨

톤 가이드라인이 존중됨

위험한 격차가 표시됨

잘못된 추론이 드러남

준수 표준이 충족됨

이는 특히 기업 및 고객 대면 AI에 중요합니다.

에이전트 평가는 AgentX의 다른 부분과 동일한 크레딧 모델을 사용합니다. 각 테스트 실행은 일반 에이전트 메시지와 동일한 방식으로 크레딧을 소모합니다 - 추가 요금 없음, 숨겨진 가격 없음. 평가가 기존 계획 한도 및 크레딧 잔액을 따르기 때문에 정확히 무엇을 소비하는지 항상 알 수 있습니다.

전통적인 소프트웨어에서 QA는 신뢰성을 보장합니다.

AgentX에서는 평가가 에이전트를 위한 QA입니다.

“좋은” 것이 무엇인지 정의합니다.

AgentX는 에이전트가 이를 일관되게 제공할 수 있는지 확인하고, 그렇지 않을 때 개선할 정확한 내용을 보여줍니다.

평가는 AI를 블랙박스에서 투명하고, 측정 가능하며, 개선 가능한 시스템으로 변환합니다.

Discover how AgentX can automate, streamline, and elevate your business operations with multi-agent workforces.

AgentX | One-stop AI Agent build platform.

Book a demo© 2026 AgentX Inc