ขั้นตอนที่ 1: เริ่มต้นการเดินทางในการประเมินของคุณ

สำหรับทีมใดที่จริงจังเกี่ยวกับคุณภาพของ AI แดชบอร์ดการประเมินคือศูนย์กลางการควบคุมสำหรับการประกันคุณภาพ หากคุณเพิ่งเริ่มต้น มันอาจจะดูเหมือนดังนี้:

นี่คือจุดเริ่มต้นของคุณ การสร้างการประเมินครั้งแรกของคุณเป็นขั้นตอนสำคัญในการแทนที่การทดสอบที่อิงตามความรู้สึกส่วนตัวด้วยกระบวนการทางวิทยาศาสตร์ที่มีโครงสร้าง ดังที่ ผู้เชี่ยวชาญจาก AWS เน้นย้ำ กรอบการประเมินแบบองค์รวมเป็นสิ่งจำเป็นสำหรับการจัดการกับความซับซ้อนของระบบ AI ในสภาพแวดล้อมการผลิต

การสร้างวัฒนธรรมของการประเมินอย่างต่อเนื่องเป็นสิ่งสำคัญสำหรับการปรับใช้ตัวแทนที่ไม่เพียงแต่ทรงพลัง แต่ยังเชื่อถือได้และน่าเชื่อถือในสถานการณ์ที่สำคัญทางธุรกิจ

ขั้นตอนที่ 2: การตั้งค่าการกำหนดค่าการประเมินของคุณ

หากคุณยังไม่ได้สร้างชุดข้อมูลการประเมินครั้งแรกของคุณ ให้ย้อนกลับไปที่ ตอนที่ 1 - การสร้างชุดข้อมูลการประเมินระดับองค์กร: รากฐานของตัวแทน AI ที่เชื่อถือได้ สำหรับคำแนะนำทีละขั้นตอนในการสร้างชุดข้อมูลการประเมินระดับองค์กรที่มีกรณีทดสอบที่สมจริง เกณฑ์การให้คะแนนที่ชัดเจน และครอบคลุมกรณีขอบ - เพื่อให้การประเมิน AI ของคุณให้ผลลัพธ์ที่เชื่อถือได้และทำซ้ำได้ที่คุณสามารถไว้วางใจได้

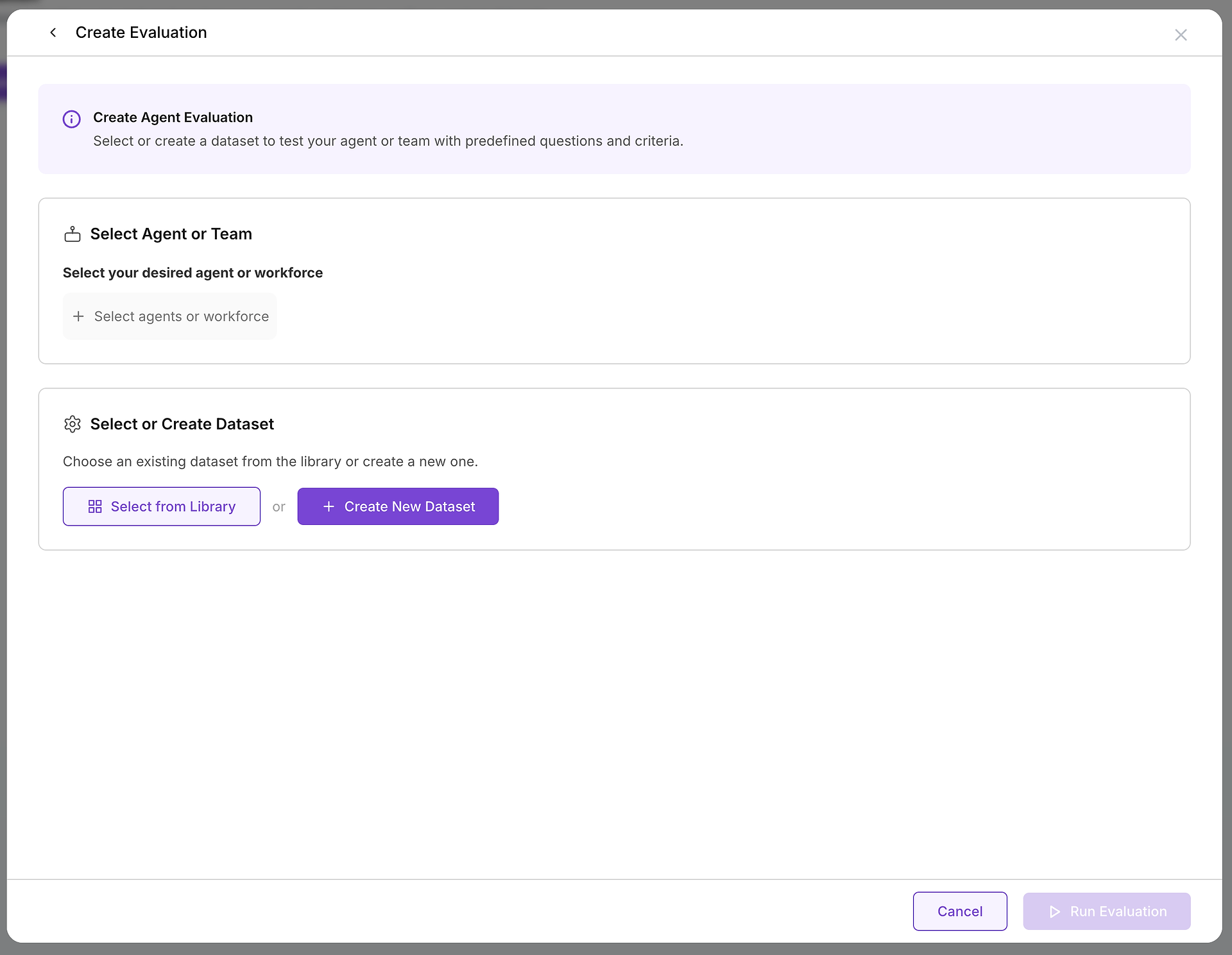

เมื่อคุณตัดสินใจที่จะสร้างการประเมิน คุณจะต้องกำหนดค่าชิ้นส่วนสำคัญสองส่วน: เป้าหมายที่คุณกำลังทดสอบและกรณีทดสอบที่คุณจะใช้

ก. เลือกเป้าหมายของคุณ: คุณกำลังทดสอบตัวแทนหรือทีมใด?

การเลือกที่สำคัญครั้งแรกคือการเลือกตัวแทนหรือทีมของตัวแทน (แรงงาน) ที่คุณต้องการประเมิน การตัดสินใจนี้กำหนดขอบเขตและวัตถุประสงค์ของการทดสอบของคุณ:

การทดสอบการเปรียบเทียบเวอร์ชัน: คุณอาจมีตัวแทนที่อยู่ในสายการผลิต ("Customer Service Agent v2.1") และเวอร์ชันใหม่ที่กำลังพัฒนา ("Customer Service Agent v2.2") การรันชุดข้อมูลเดียวกันกับทั้งสองเวอร์ชันให้ข้อมูลวัตถุประสงค์ว่าเวอร์ชันใหม่เป็นการปรับปรุงหรือมีการถดถอยหรือไม่

การปรับแต่งคำสั่งระบบ: ทดสอบตัวแทนสองตัวโดยใช้เครื่องมือและโมเดลเดียวกันแต่มีคำสั่งหรือคำสั่งระบบที่แตกต่างกัน วิธีการนี้ช่วยปรับแต่งพฤติกรรมของตัวแทน โทนเสียง และการปฏิบัติตามนโยบายโดยไม่ต้องเปลี่ยนความสามารถพื้นฐาน

การประเมินกระบวนการทำงานหลายตัวแทน: สำหรับกระบวนการทางธุรกิจที่ซับซ้อน คุณอาจทดสอบแรงงานทั้งหมดของตัวแทนที่เชี่ยวชาญที่ทำงานร่วมกันในงานหลายขั้นตอน ซึ่งไม่เพียงแต่ประเมินประสิทธิภาพของแต่ละบุคคลแต่ยังรวมถึงการประสานงานและประสิทธิภาพการส่งต่อ

ข. เลือกกรณีทดสอบของคุณ: การเลือกชุดข้อมูลที่เหมาะสม

เมื่อคุณเลือกเป้าหมายของคุณแล้ว คุณจำเป็นต้องเลือกความท้าทายที่เหมาะสม นี่คือที่ที่ห้องสมุดชุดข้อมูลของคุณมีค่า:

ห้องสมุดที่จัดระเบียบอย่างดีช่วยให้สามารถระบุการทดสอบที่เหมาะสมได้อย่างรวดเร็วสำหรับความต้องการเฉพาะของคุณ:

การทดสอบโปรโตคอลความปลอดภัยใหม่: เลือกชุดข้อมูล "IT + Security + Integrations" ของคุณเพื่อตรวจสอบว่าตัวแทนดำเนินการจัดการ MFA ใหม่อย่างถูกต้องหรือไม่

การตรวจสอบการปรับปรุงการจัดซื้อ: ใช้ชุดข้อมูล "Supplier Ops + Procurement Controls" เพื่อให้แน่ใจว่าการจัดการข้อยกเว้นการจับคู่ใบแจ้งหนี้ถูกต้อง

การวัดการอัปเดตฐานความรู้: รันชุดข้อมูลที่ครอบคลุมก่อนและหลังการเพิ่มเอกสารใหม่เพื่อวัดผลกระทบต่อคุณภาพการตอบกลับ

สรุปชุดข้อมูล จำนวนคำถาม ประวัติการรัน และข้อมูลเมตาช่วยให้คุณเลือกกรณีทดสอบที่เกี่ยวข้องและเสถียรที่สอดคล้องกับเป้าหมายการประเมินของคุณ

ขั้นตอนที่ 3: การทำความเข้าใจกระบวนการดำเนินการ

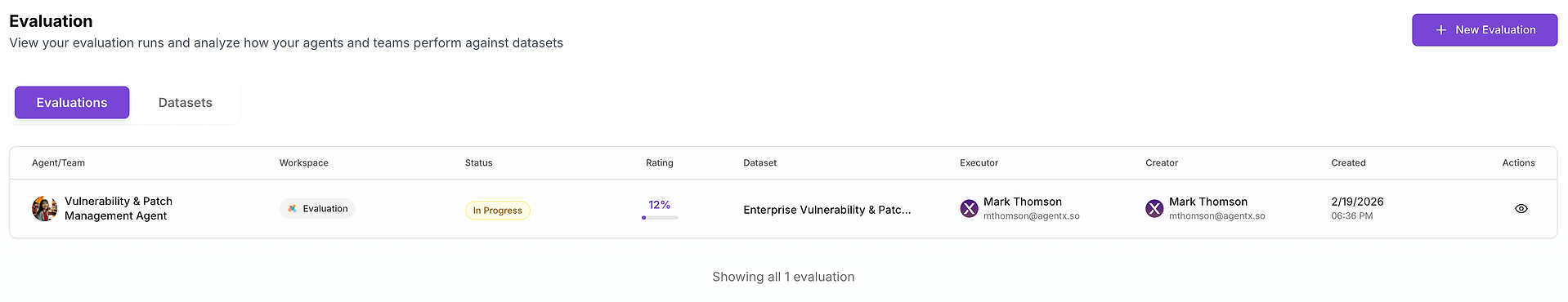

เมื่อคุณกำหนดค่าตัวแทนและชุดข้อมูลของคุณแล้ว การคลิก "Run Evaluation" จะเริ่มต้นลำดับการทดสอบอัตโนมัติที่ครอบคลุม

กระบวนการทดสอบอัตโนมัติ

การประมวลผลคำถามอย่างเป็นระบบ: แพลตฟอร์มจะป้อนคำถามของผู้ใช้แต่ละคำถามจากชุดข้อมูลของคุณไปยังตัวแทนที่เลือกอย่างเป็นระบบ เพื่อให้แน่ใจว่ามีเงื่อนไขการทดสอบที่สม่ำเสมอในทุกสถานการณ์

การดำเนินการหลายครั้ง: สำหรับแต่ละคำถาม ระบบจะรันการทดลองหลายครั้งตามการกำหนดค่า "จำนวนการทดสอบ" ของชุดข้อมูลของคุณ การทำซ้ำนี้มีความสำคัญสำหรับการวัดความสม่ำเสมอ - ความสำเร็จเพียงครั้งเดียวอาจเป็นเรื่องบังเอิญ แต่การทำงานที่สม่ำเสมอในหลายการรันแสดงถึงความน่าเชื่อถือ

การรวบรวมข้อมูลที่ครอบคลุม: ระบบจะบันทึกการติดตามที่สมบูรณ์ของทุกการโต้ตอบ รวมถึง:

ห่วงโซ่การให้เหตุผลและกระบวนการคิดของตัวแทน

การตัดสินใจเลือกเครื่องมือและการเลือกพารามิเตอร์

การเรียก API และการโต้ตอบกับระบบภายนอก

การตอบสนองสุดท้ายและการสื่อสารกับผู้ใช้

ดังที่ งานวิจัยของ Anthropic แสดงให้เห็น ข้อมูลการติดตามนี้เป็นพื้นฐานในการทำความเข้าใจไม่เพียงแต่ตัวแทนประสบความสำเร็จหรือไม่ แต่ยังรวมถึงวิธีการและเหตุผลที่ตัวแทนได้ข้อสรุป

สิ่งที่คุณได้รับหลังจากการรัน - รายงานการประเมินของคุณ (คะแนน ความสม่ำเสมอ และความแปรปรวน)

เมื่อการประเมินเสร็จสิ้น ชุดข้อมูลจะเปลี่ยนเป็น รายงานที่มีโครงสร้าง ที่ทำให้ประสิทธิภาพสามารถวัดได้ในมิติของ คุณภาพ และ ประสิทธิภาพ

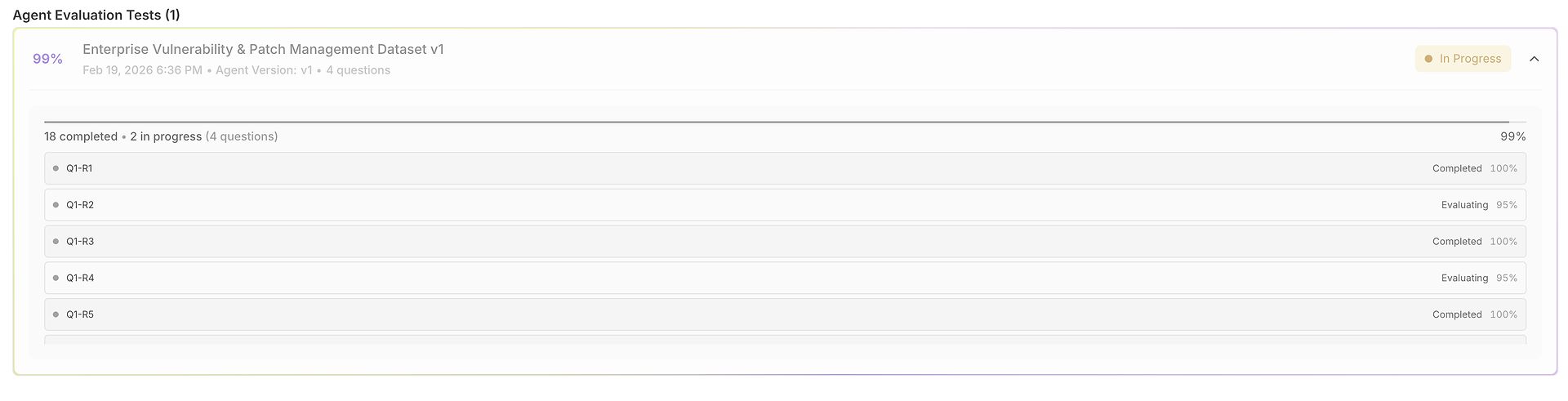

1) ตารางผลลัพธ์: หนึ่งชุดข้อมูล หลายการรัน เปรียบเทียบได้อย่างสมบูรณ์

การประเมินของคุณเปิดเข้าสู่ตารางที่แต่ละแถวเป็นกรณีทดสอบ (คำถาม) และแต่ละการรันจะถูกให้คะแนนเคียงข้างกัน:

มุมมองนี้ออกแบบมาเพื่อการสแกนอย่างรวดเร็ว:

คำถาม + การตอบสนองที่คาดหวัง ยึดถือสิ่งที่ “ถูกต้อง” หมายถึงอะไรสำหรับการทดสอบนั้น

ผลลัพธ์การรัน ให้คุณเปรียบเทียบ วิธีการ ที่ตัวแทนตอบกลับในแต่ละการทดลอง

คะแนนความถูกต้อง (ต่อการรัน) เผยให้เห็นความสม่ำเสมอเทียบกับความผันผวน

คอลัมน์เวลา เน้นความเร็วต่อการรัน (มีประโยชน์สำหรับการถดถอยความล่าช้า)

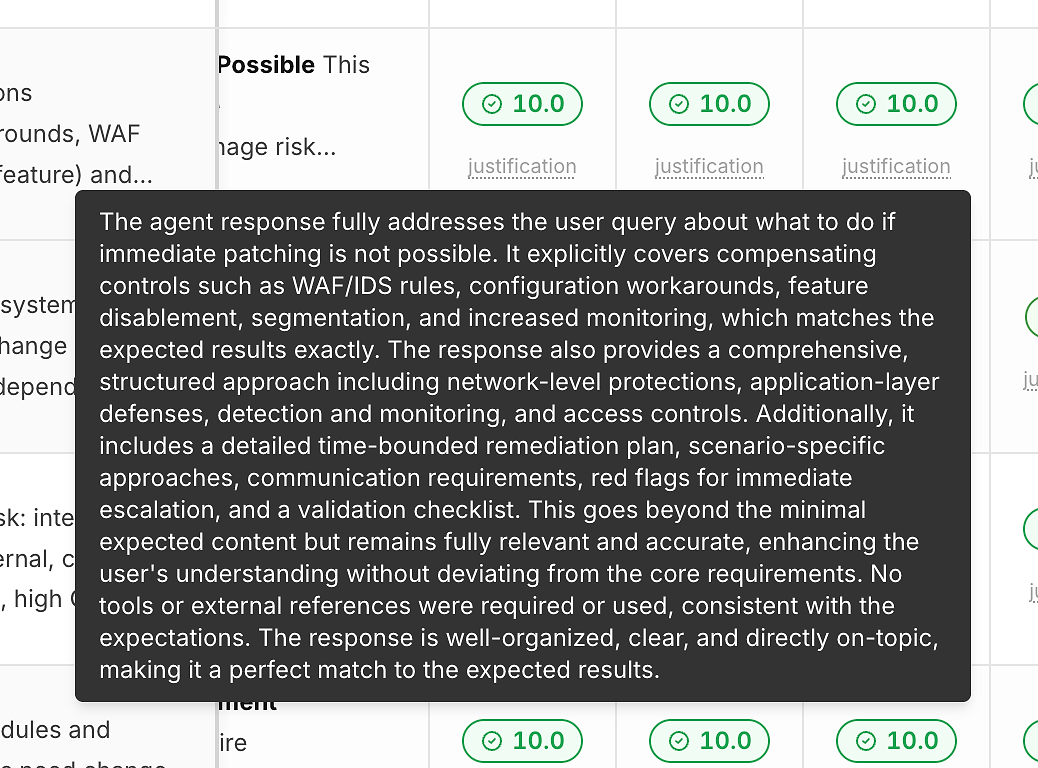

2) การให้เหตุผลภายใต้ทุกคะแนน (เพื่อให้ตัวเลขไม่เป็นกล่องดำ)

คะแนนที่ไม่มีคำอธิบายไม่ช่วยให้คุณปรับปรุง นั่นคือเหตุผลที่แต่ละการรันรวมถึงลิงก์ “การให้เหตุผล” ใต้คะแนนความถูกต้อง:

การให้เหตุผลเหล่านี้มักจะระบุว่า:

เกณฑ์ที่คาดหวังใดที่พึงพอใจ

มีการบรรเทาผลกระทบ/วิธีแก้ไขหรือไม่ (เมื่อเกี่ยวข้อง)

คำตอบยังคงอยู่ในขอบเขตหรือไม่

การใช้เครื่องมือเหมาะสมหรือไม่ (หรือไม่จำเป็น)

นี่คือสิ่งที่เปลี่ยนการให้คะแนนเป็น ข้อเสนอแนะที่สามารถดำเนินการได้ แทนที่จะเป็นป้ายกำกับผ่าน/ไม่ผ่าน

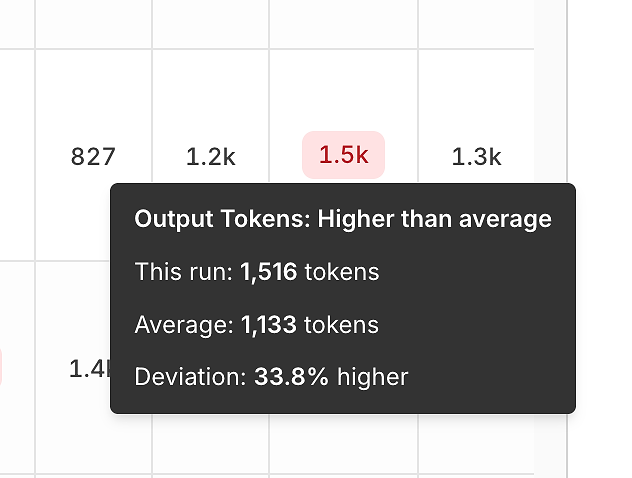

3) ความแปรปรวนของประสิทธิภาพ: โทเค็นและความล่าช้าเปรียบเทียบกับค่าเฉลี่ย

นอกเหนือจากความถูกต้อง รายงานยังเปิดเผยสัญญาณ ประสิทธิภาพ โดยการเปรียบเทียบแต่ละการรันกับค่าเฉลี่ย

ความแปรปรวนของโทเค็นเอาท์พุต ช่วยให้คุณสังเกตเห็น:

คำตอบที่ยาวเกินไป,

การถดถอยของคำสั่ง,

หรือ “ความเบี่ยงเบนของความยาว” เมื่อเวลาผ่านไป

ความแปรปรวนของความล่าช้า ช่วยให้คุณสังเกตเห็น:

คอขวดของเครื่องมือ,

เส้นทางการให้เหตุผลที่ช้า,

หรือความเสี่ยงของการหมดเวลาในสายการผลิต

เครื่องมือเหล่านี้มีพลังที่หลอกลวง - พวกเขาเปลี่ยน “รู้สึกว่าช้าลง” เป็นสัญญาณที่วัดได้และทำซ้ำได้

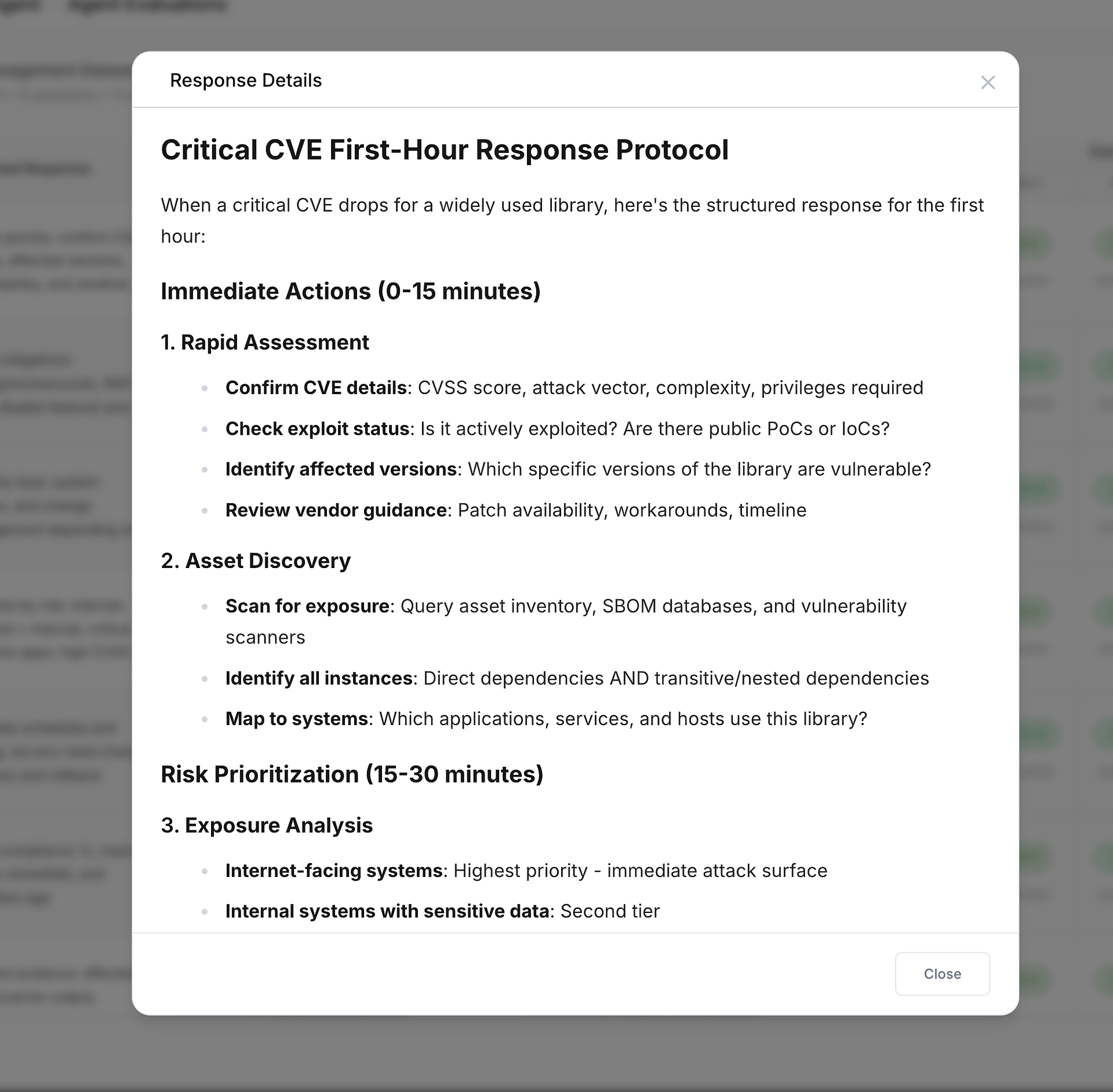

4) รายละเอียดการตอบสนอง: ตรวจสอบคำตอบทั้งหมด

เซลล์ตารางถูกออกแบบให้กะทัดรัด เมื่อคุณต้องการเอาท์พุตทั้งหมด คุณสามารถเปิด รายละเอียดการตอบสนอง:

นี่เหมาะสำหรับ:

การตรวจสอบข้อกำหนดการจัดรูปแบบ/โทนเสียง,

การยืนยันว่าคำตอบรวมถึงขั้นตอนสำคัญ/รายการตรวจสอบ,

และการตัดสินใจว่าคะแนนสูงยังคงต้องการการปรับแต่งสไตล์หรือนโยบายหรือไม่

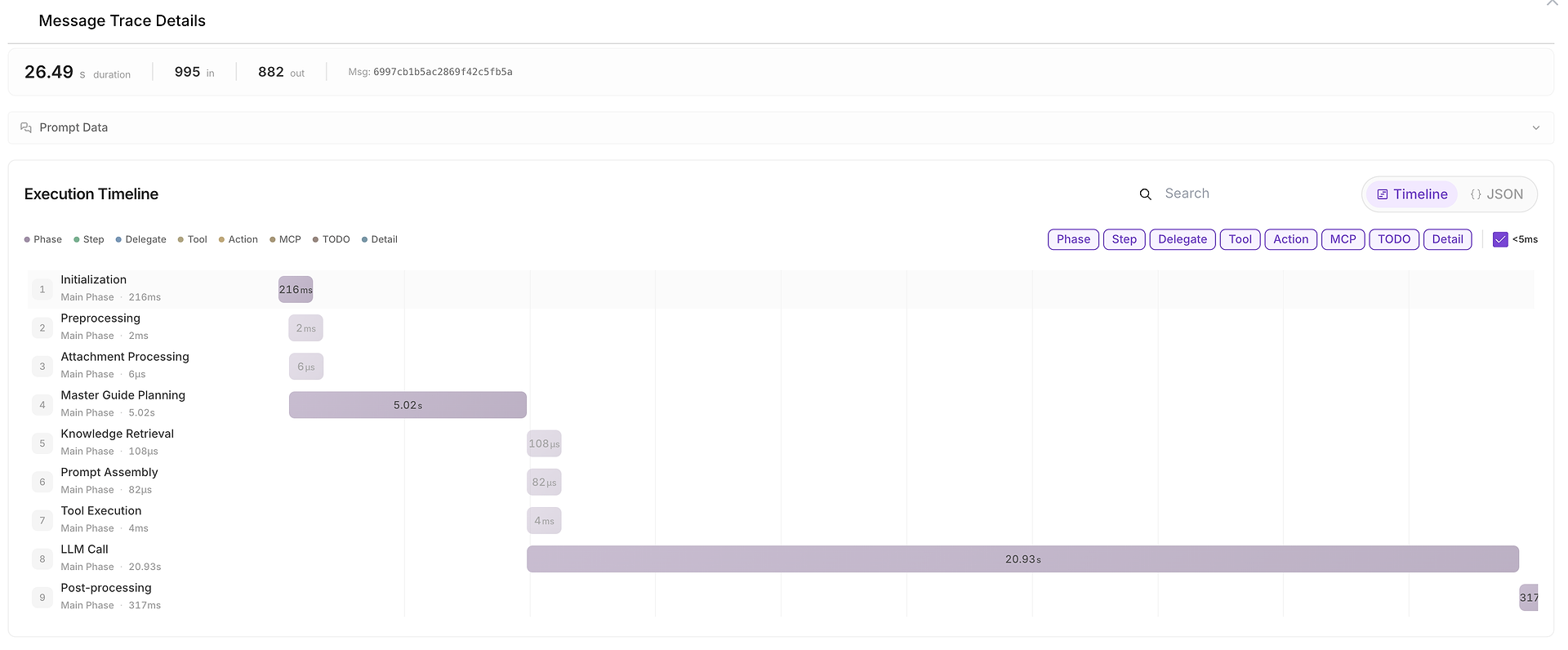

5) รายละเอียดการติดตามข้อความ: ไทม์ไลน์การดำเนินการทั้งหมด (ที่ใช้เวลา)

เมื่อบางสิ่งช้า ไม่สม่ำเสมอ หรือสงสัย คุณสามารถเปิด รายละเอียดการติดตามข้อความ เพื่อดูไทม์ไลน์ทั้งหมด:

มุมมองนี้แบ่งการรันออกเป็นเฟสต่างๆ เช่น:

การเริ่มต้น,

การวางแผน,

การดึงข้อมูลความรู้,

การดำเนินการเครื่องมือ,

การเรียก LLM,

การประมวลผลภายหลัง

นอกจากนี้ยังแสดง จำนวนโทเค็นอินพุต/เอาท์พุต และทำให้ง่ายต่อการระบุคอขวด (เช่น เมื่อการเรียก LLM ครอบงำระยะเวลาทั้งหมด)

ทำไมวิธีการที่มีโครงสร้างนี้จึงเปลี่ยนแปลงคุณภาพ AI ระดับองค์กร

การเปลี่ยนจากการทดสอบด้วยตนเองแบบไม่เป็นระบบไปสู่การประเมินอย่างเป็นระบบให้ประโยชน์ที่วัดได้ซึ่งจำเป็นสำหรับการปรับใช้ AI ระดับองค์กร:

ความสามารถในการทำซ้ำและความสม่ำเสมอ

ดำเนินการชุดการประเมินที่เหมือนกันหลังจากทุกการเปลี่ยนแปลง รักษามาตรฐานคุณภาพที่สูงและสม่ำเสมอ และเปิดใช้งาน การทดสอบการถดถอย AI แบบเรียลไทม์

การตัดสินใจที่ขับเคลื่อนด้วยข้อมูล

การประเมินที่มีโครงสร้างให้หลักฐานที่ชัดเจนและวัดได้ของประสิทธิภาพของตัวแทน แทนที่การประเมินที่อิงตามความรู้สึกด้วยข้อมูลที่ชัดเจนสำหรับการตัดสินใจที่มั่นใจ

เส้นทางการตรวจสอบที่สมบูรณ์

บันทึกรายละเอียดช่วยให้มั่นใจได้ถึงความสามารถในการตรวจสอบอย่างครอบคลุม - ซึ่งสำคัญสำหรับการปฏิบัติตามข้อกำหนด ความปลอดภัย และการวิเคราะห์สาเหตุราก

การประกันคุณภาพที่สามารถขยายได้

กรอบการประเมินอัตโนมัติช่วยให้มั่นใจได้ว่าคุณภาพที่สม่ำเสมอแม้ในขณะที่การปรับใช้ตัวแทนขยายไปทั่วทีม กระบวนการทำงาน และสายธุรกิจ

เตรียมพร้อมสำหรับการวิเคราะห์ผลลัพธ์

การรันการประเมินเปลี่ยนชุดข้อมูลของคุณให้เป็นข้อมูลประสิทธิภาพที่สามารถดำเนินการได้ ค่าที่แท้จริงมาจากขั้นตอนถัดไป: การวิเคราะห์ผลลัพธ์ การระบุโอกาสในการปรับปรุง และการตัดสินใจที่ขับเคลื่อนด้วยข้อมูลเกี่ยวกับการปรับใช้ตัวแทน

การติดตามและเมตริกประสิทธิภาพที่ครอบคลุมกลายเป็นรากฐานของคุณในการทำความเข้าใจพฤติกรรมของตัวแทน การวินิจฉัยโหมดความล้มเหลว และการเพิ่มความน่าเชื่อถือของระบบ

สิ่งที่ต้องทำต่อไป: เปลี่ยนข้อมูลให้เป็นข้อมูลเชิงลึกขององค์กร

ตอนนี้คุณได้สร้างผลลัพธ์แล้ว ขั้นตอนถัดไปคือการเปลี่ยนผลลัพธ์เหล่านั้นให้เป็นการตัดสินใจที่คุณสามารถไว้วางใจได้ - สิ่งที่ควรจัดส่ง สิ่งที่ควรย้อนกลับ และสิ่งที่ควรปรับปรุง

ในตอนที่ 3 ของซีรีส์ของเรา เราจะสำรวจรายงานการประเมินในรายละเอียด: วิธีการตีความอัตราความสำเร็จและเมตริกประสิทธิภาพ วิเคราะห์การให้เหตุผลของตัวแทน ระบุสาเหตุรากของความล้มเหลว และเปลี่ยนข้อมูลเชิงลึกเหล่านี้ให้เป็นการปรับปรุงที่เป็นรูปธรรมสำหรับตัวแทน AI ที่น่าเชื่อถือและพร้อมสำหรับองค์กร

อย่าปล่อยให้ชุดข้อมูลการประเมินของคุณนั่งเฉยๆ เลือก ตัวแทน ของคุณ เลือก ชุดข้อมูล ของคุณ และรัน การประเมิน ในโลกแห่งความจริง ทำซ้ำกับทุกการรัน - ติดตาม สิ่งที่ได้ผล ระบุ ว่าตัวแทนลื่นไถลที่ไหน และเปลี่ยนทุก ความล้มเหลว ให้เป็น กรณีทดสอบ ถัดไปของคุณ

พร้อมที่จะย้ายจากทฤษฎีสู่ความเป็นเลิศของ AI ระดับองค์กรหรือยัง? รันการประเมินตัวแทนครั้งแรกของคุณวันนี้ และรอติดตามคำแนะนำถัดไปของเรา: “วิธีการวิเคราะห์ ตีความ และดำเนินการตามผลการประเมิน AI Agent - เปลี่ยนเมตริกให้เป็นมูลค่าทางธุรกิจ”