الخطوة 1: بدء رحلتك التقييمية

بالنسبة لأي فريق جاد بشأن جودة الذكاء الاصطناعي، فإن لوحة التحكم التقييمية هي مركز القيادة لضمان الجودة. إذا كنت قد بدأت للتو، فقد تبدو شيئًا كهذا:

هذا هو خط البداية الخاص بك. إنشاء تقييمك الأول هو الخطوة الحاسمة نحو استبدال الاختبار الذاتي "الشعور الداخلي" بعملية علمية منظمة. كما يؤكد خبراء AWS، فإن إطار التقييم الشامل ضروري لمعالجة تعقيد أنظمة الذكاء الاصطناعي الوكيلية في بيئات الإنتاج.

إنشاء ثقافة التقييم المستمر أمر حاسم لنشر وكلاء ليسوا فقط أقوياء، ولكن أيضًا موثوقين ويمكن الاعتماد عليهم في السيناريوهات الحرجة للأعمال.

الخطوة 2: إعداد تكوين التقييم الخاص بك

إذا لم تقم بإنشاء مجموعة البيانات التقييمية الأولى الخاصة بك بعد، فارجع إلى الجزء 1 - بناء مجموعات البيانات التقييمية على مستوى المؤسسة: أساس وكلاء الذكاء الاصطناعي الموثوقين للحصول على دليل خطوة بخطوة لبناء مجموعات البيانات التقييمية على مستوى المؤسسة مع حالات اختبار واقعية، ومعايير تسجيل واضحة، وتغطية للحالات الحافة - بحيث تنتج تقييمات وكلاء الذكاء الاصطناعي نتائج موثوقة وقابلة للتكرار يمكنك الوثوق بها.

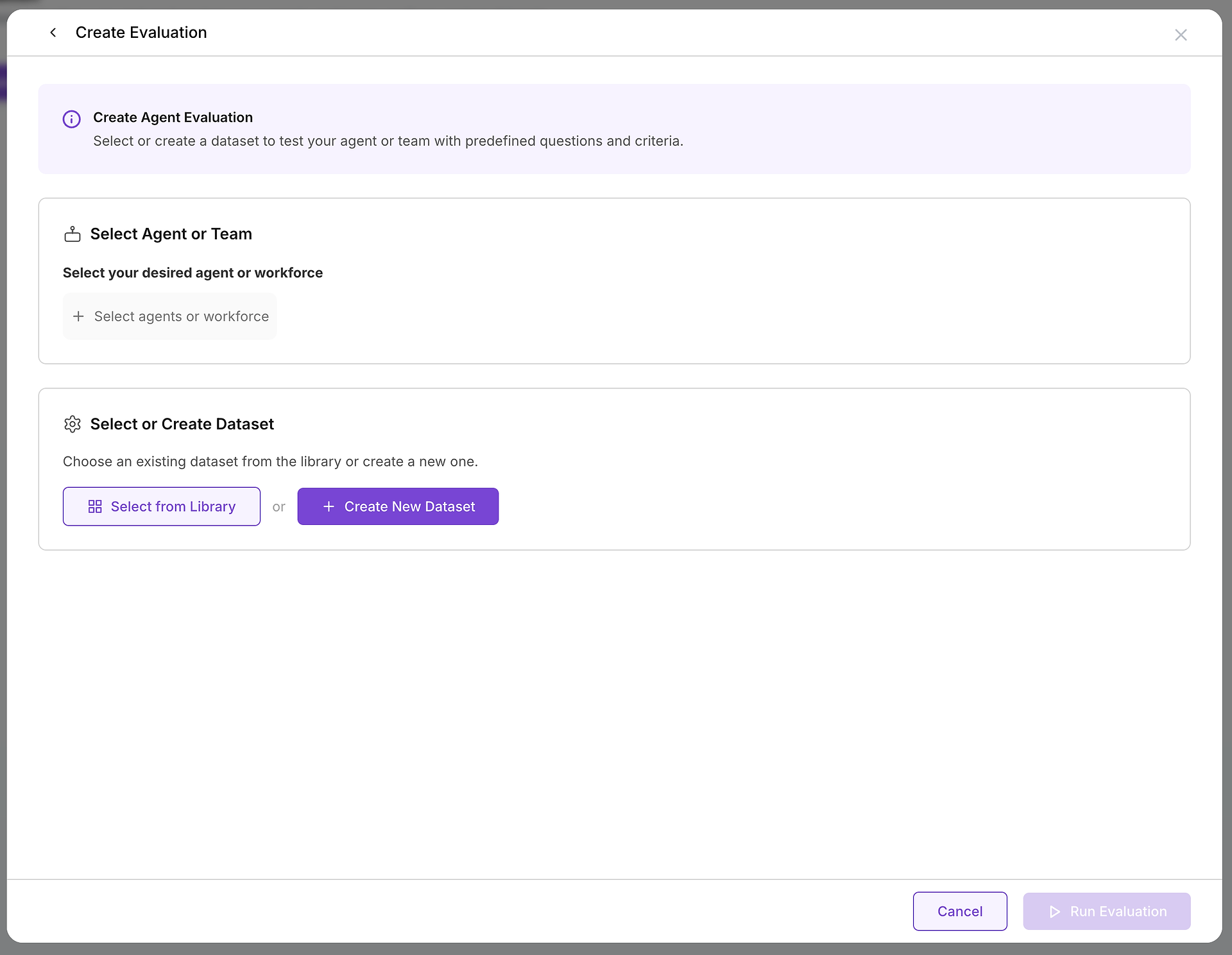

بمجرد أن تقرر إنشاء تقييم، ستقوم بتكوين مكونين أساسيين: الهدف الذي تقوم باختباره وحالات الاختبار التي ستستخدمها.

أ. اختر هدفك: أي وكيل أو فريق تقوم باختباره؟

الاختيار الحاسم الأول هو اختيار الوكيل أو فريق الوكلاء (قوة العمل) الذي تريد تقييمه. يحدد هذا القرار نطاق وغرض اختبارك:

اختبار مقارنة الإصدارات: قد يكون لديك وكيل في الإنتاج ("وكيل خدمة العملاء v2.1") وإصدار جديد قيد التطوير ("وكيل خدمة العملاء v2.2"). تشغيل نفس مجموعة البيانات ضد كلا الإصدارين يوفر بيانات موضوعية حول ما إذا كان الإصدار الجديد يمثل تحسنًا أو يقدم تراجعات.

تحسين التعليمات النظامية: اختبار وكيلين باستخدام أدوات ونماذج متطابقة ولكن مع تعليمات أو مطالبات نظام مختلفة. يساعد هذا النهج في تحسين سلوك الوكيل، ونغمة الصوت، والالتزام بالسياسات دون تغيير القدرات الأساسية.

تقييم سير العمل متعدد الوكلاء: بالنسبة للعمليات التجارية المعقدة، قد تختبر قوة عمل كاملة من الوكلاء المتخصصين الذين يتعاونون في مهام متعددة الخطوات. يقيم هذا ليس فقط الأداء الفردي ولكن أيضًا فعالية التنسيق والتسليم.

ب. اختر حالات الاختبار الخاصة بك: اختيار مجموعة البيانات الصحيحة

مع تحديد هدفك، تحتاج إلى اختيار التحدي المناسب. هنا تصبح مكتبة مجموعات البيانات الخاصة بك لا تقدر بثمن:

تتيح لك مكتبة منظمة جيدًا تحديد الاختبار الصحيح بسرعة لاحتياجاتك المحددة:

اختبار بروتوكولات الأمان الجديدة: اختر مجموعة البيانات "IT + Security + Integrations" للتحقق من أن الوكيل ينفذ بشكل صحيح إجراءات التعامل مع MFA الجديدة.

التحقق من تحسينات المشتريات: استخدم مجموعة البيانات "Supplier Ops + Procurement Controls" لضمان التعامل الصحيح مع استثناءات مطابقة الفواتير.

قياس تحديثات قاعدة المعرفة: تشغيل مجموعة بيانات شاملة قبل وبعد إضافة وثائق جديدة لقياس التأثير على جودة الاستجابة.

تساعدك ملخصات مجموعات البيانات، وعدد الأسئلة، وتواريخ التشغيل، والبيانات الوصفية في اختيار حالات الاختبار ذات الصلة والمستقرة التي تتماشى مع أهداف التقييم الخاصة بك.

الخطوة 3: فهم عملية التنفيذ

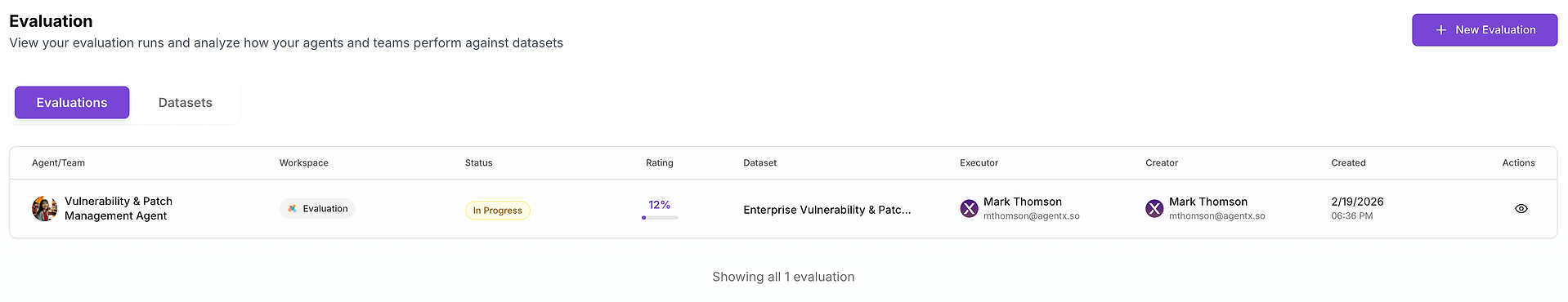

مع تكوين وكيلك ومجموعة البيانات الخاصة بك، يؤدي النقر على "Run Evaluation" إلى بدء تسلسل اختبار آلي وشامل.

سير العمل الآلي للاختبار

معالجة الأسئلة بشكل منهجي: يقوم النظام بتغذية كل استفسار من المستخدم من مجموعة البيانات الخاصة بك إلى الوكيل المحدد، مما يضمن شروط اختبار متسقة عبر جميع السيناريوهات.

تنفيذ تجارب متعددة: بالنسبة لكل استفسار، يقوم النظام بتشغيل تجارب متعددة بناءً على تكوين "عدد مرات الاختبار" في مجموعة البيانات الخاصة بك. هذا التكرار ضروري لقياس الاتساق - قد يكون النجاح الفردي مصادفة، ولكن الأداء المتسق عبر تجارب متعددة يثبت الموثوقية.

جمع البيانات الشامل: يقوم النظام بالتقاط تتبع كامل لكل تفاعل، بما في ذلك:

سلاسل التفكير والاستنتاجات للوكيل

قرارات اختيار الأدوات وخيارات المعلمات

مكالمات API والتفاعلات مع الأنظمة الخارجية

الاستجابات النهائية والتواصل مع المستخدمين

كما توضح أبحاث Anthropic، فإن بيانات التتبع هذه أساسية لفهم ليس فقط ما إذا كان الوكيل قد نجح، ولكن كيف ولماذا توصل إلى استنتاجاته.

ما تحصل عليه بعد التشغيل - تقرير التقييم الخاص بك (الدرجات، الاتساق، والتباين)

بمجرد اكتمال التقييم، تتحول مجموعة البيانات إلى تقرير منظم يجعل الأداء قابلاً للقياس عبر أبعاد الجودة والأداء.

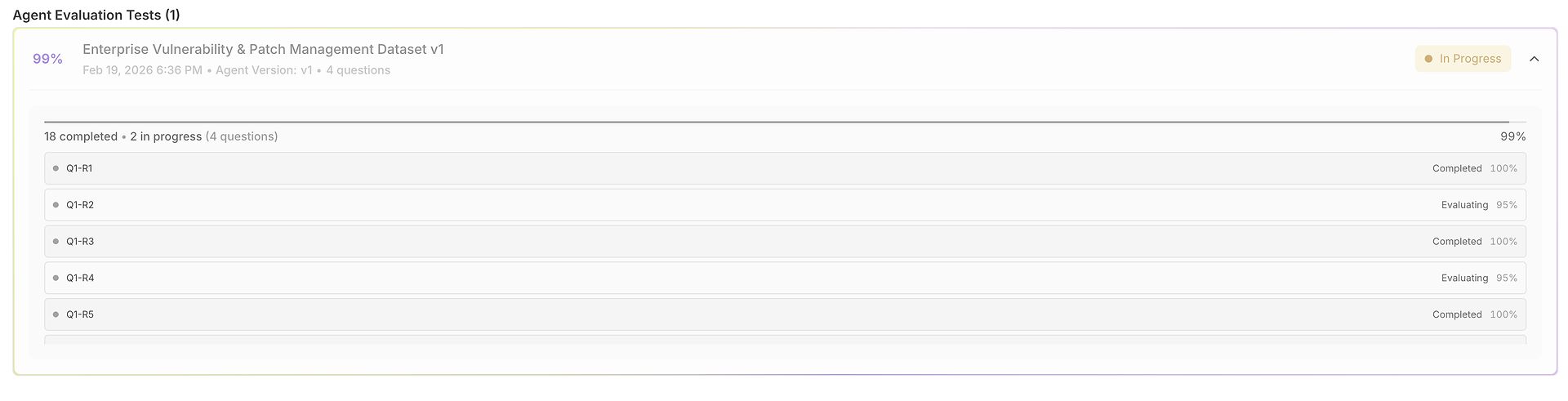

1) شبكة النتائج: مجموعة بيانات واحدة، العديد من التشغيلات، قابلة للمقارنة بالكامل

يفتح تقييمك في شبكة حيث يكون كل صف حالة اختبار (سؤال) وكل تشغيل يتم تسجيله جنبًا إلى جنب:

تم تصميم هذا العرض للمسح السريع:

السؤال + الاستجابة المتوقعة تثبت ما يعنيه "الصحيح" لهذا الاختبار.

مخرجات التشغيل تتيح لك مقارنة كيف أجاب الوكيل عبر التجارب.

درجات الصحة (لكل تشغيل) تكشف عن الاتساق مقابل التقلب.

أعمدة التوقيت تسلط الضوء على السرعة لكل تشغيل (مفيدة لتراجعات التأخير).

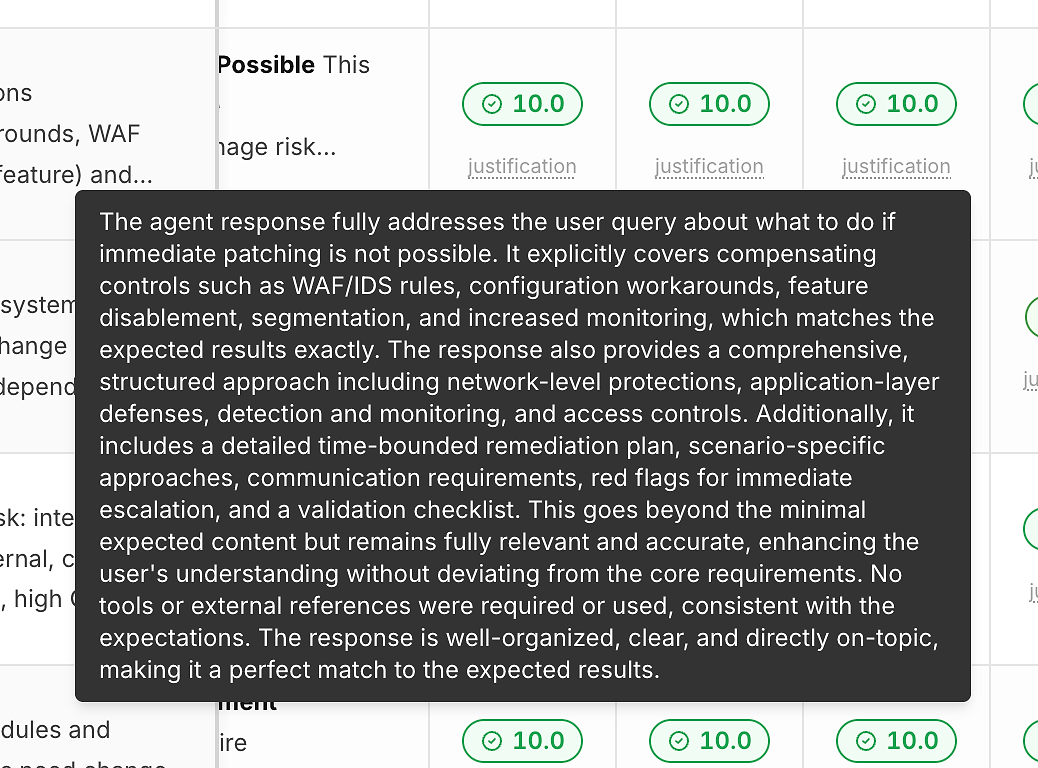

2) التبرير تحت كل درجة (حتى لا تكون الأرقام صندوقًا أسود)

الدرجة بدون تفسير لا تساعدك على التحسين. لهذا السبب يتضمن كل تشغيل رابط "التبرير" تحت درجة الصحة الخاصة به:

عادةً ما تشير هذه التبريرات إلى:

ما هي المعايير المتوقعة التي تم تلبيتها

ما إذا كانت التخفيفات/الحلول البديلة قد تم تضمينها (عند الاقتضاء)

ما إذا كانت الإجابة بقيت ضمن النطاق مقابل الانحراف

ما إذا كان استخدام الأدوات مناسبًا (أو غير ضروري)

هذا هو ما يحول التقييم إلى ملاحظات قابلة للتنفيذ بدلاً من تصنيف النجاح/الفشل.

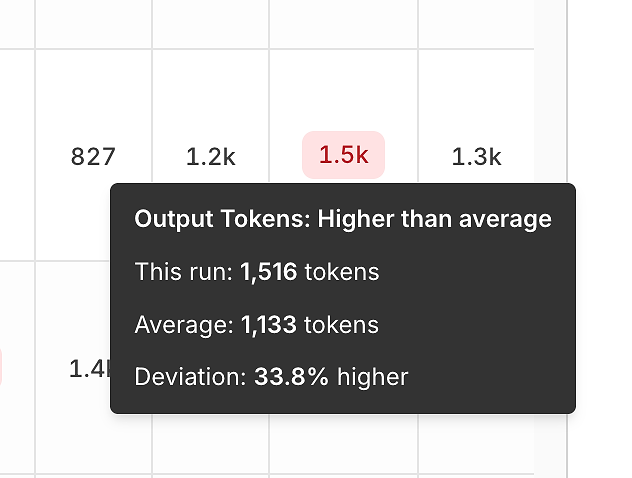

3) تباين الأداء: الرموز والكمون مقارنة بالمتوسط

بخلاف الصحة، يكشف التقرير عن إشارات الكفاءة من خلال مقارنة كل تشغيل بالمتوسط.

تباين رموز الإخراج يساعدك على اكتشاف:

الإجابات المتضخمة،

تراجعات المطالبات،

أو "انحراف الثرثرة" بمرور الوقت.

تباين الكمون يساعدك على اكتشاف:

اختناقات الأدوات،

مسارات التفكير البطيئة،

أو مخاطر النموذج/التوقيت في الإنتاج.

هذه التلميحات قوية بشكل خادع - فهي تحول "يبدو أبطأ" إلى إشارة قابلة للقياس وقابلة للتكرار.

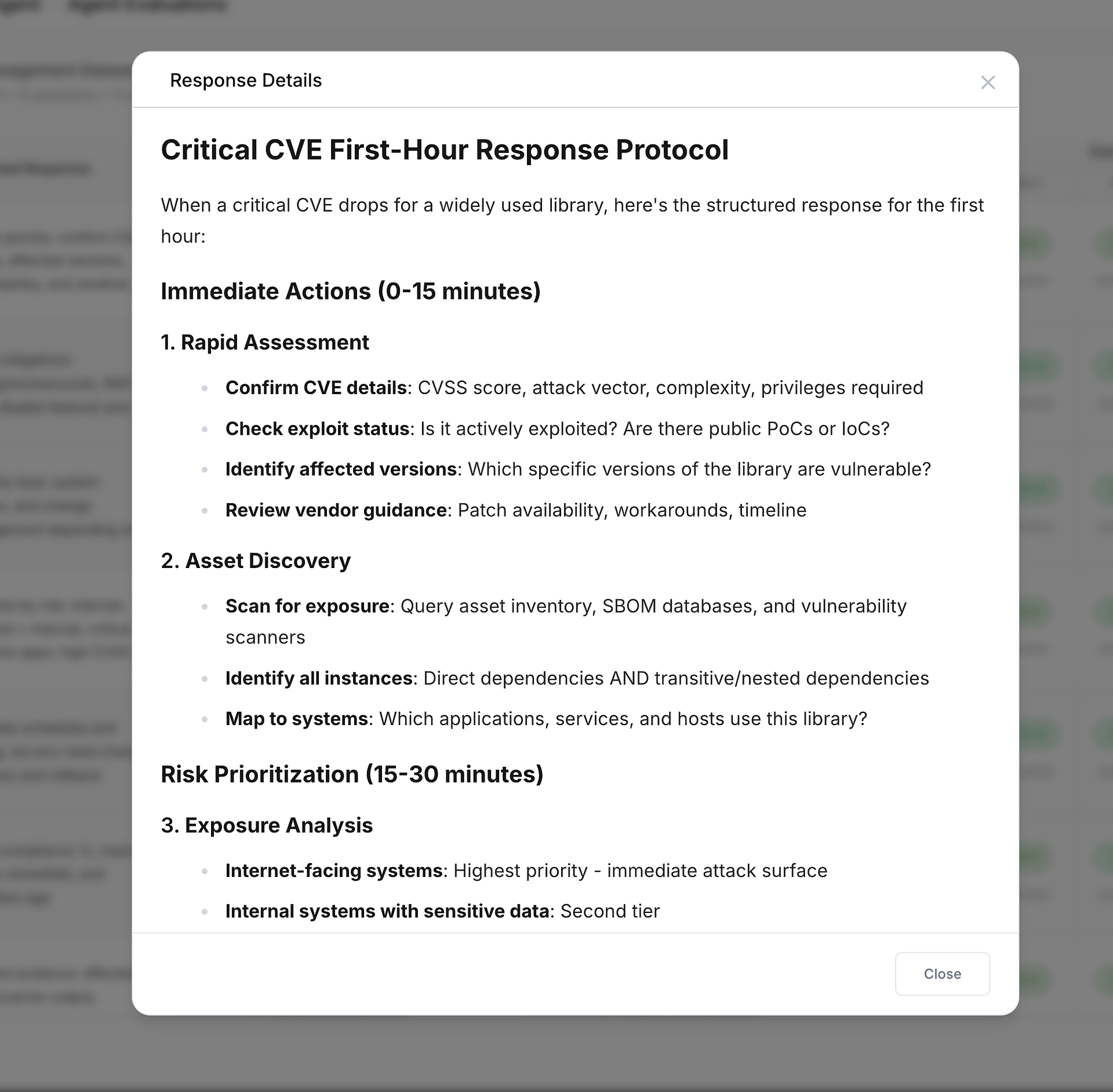

4) تفاصيل الاستجابة: فحص الإجابة الكاملة

تم تصميم خلايا الشبكة لتكون مضغوطة. عندما تحتاج إلى الإخراج الكامل، يمكنك فتح تفاصيل الاستجابة:

هذا مثالي لـ:

التحقق من متطلبات التنسيق/النغمة،

التأكد من أن الإجابة تتضمن الخطوات/القوائم الرئيسية،

واتخاذ قرار ما إذا كانت "الدرجة العالية" لا تزال بحاجة إلى تحسين في الأسلوب أو السياسة.

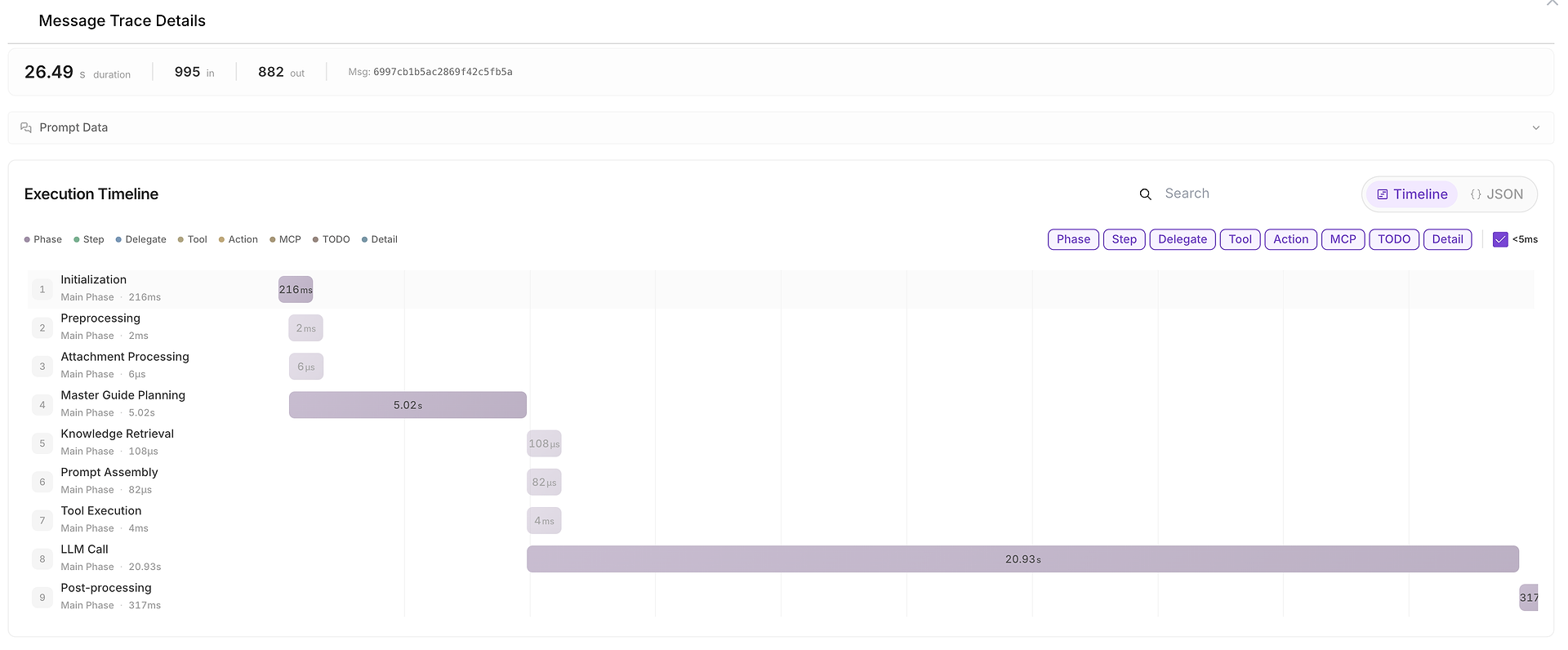

5) تفاصيل تتبع الرسائل: الجدول الزمني الكامل للتنفيذ (أين تم قضاء الوقت)

عندما يكون هناك شيء بطيء أو غير متسق أو مشبوه، يمكنك فتح تفاصيل تتبع الرسائل لرؤية الجدول الزمني الكامل:

يقسم هذا العرض التشغيل إلى مراحل مثل:

التهيئة،

التخطيط،

استرجاع المعرفة،

تنفيذ الأدوات،

مكالمة LLM،

المعالجة اللاحقة.

كما يعرض عدد رموز الإدخال/الإخراج ويسهل تحديد الاختناقات (على سبيل المثال، عندما تهيمن مكالمة LLM على مدة النهاية إلى النهاية).

لماذا يحول هذا النهج المنظم جودة الذكاء الاصطناعي للمؤسسات

الانتقال من الاختبار اليدوي العشوائي إلى التقييم المنهجي يوفر فوائد قابلة للقياس وهي ضرورية لنشر الذكاء الاصطناعي على مستوى المؤسسة:

التكرار والاتساق

تنفيذ مجموعات التقييم المتطابقة بعد كل تغيير، والحفاظ على معيار جودة مرتفع ومتسق وتمكين اختبار التراجع للذكاء الاصطناعي في الوقت الحقيقي.

اتخاذ القرارات القائمة على البيانات

يقدم التقييم المنظم أدلة موضوعية وقابلة للقياس على أداء الوكيل، مما يستبدل التقييمات الذاتية ببيانات واضحة لاتخاذ قرارات واثقة.

سجلات تدقيق كاملة

تضمن السجلات التفصيلية إمكانية التدقيق الشامل - وهو أمر حاسم للامتثال والأمان وتحليل الأسباب الجذرية.

ضمان الجودة القابل للتوسع

تُمكّن أطر التقييم الآلي من الحفاظ على الجودة المتسقة حتى مع توسع نشر الوكلاء عبر الفرق وسير العمل وخطوط الأعمال.

التحضير لتحليل النتائج

تحويل التقييم لمجموعة البيانات الخاصة بك إلى بيانات أداء قابلة للتنفيذ. تأتي القيمة الحقيقية في المرحلة التالية: تحليل النتائج، وتحديد فرص التحسين، واتخاذ القرارات القائمة على البيانات بشأن نشر الوكلاء.

تصبح التتبعات الشاملة ومقاييس الأداء أساسك لفهم سلوك الوكيل، وتشخيص أوضاع الفشل، وتحسين موثوقية النظام.

ما التالي: تحويل البيانات إلى رؤى مؤسسية

الآن بعد أن قمت بتوليد النتائج، الخطوة التالية هي تحويلها إلى قرارات يمكنك الوثوق بها - ما الذي يجب شحنه، وما الذي يجب التراجع عنه، وما الذي يجب تحسينه.

في الجزء 3 من سلسلتنا، سنستكشف تقارير التقييم بالتفصيل: كيفية تفسير معدلات النجاح ومقاييس الأداء، وتحليل التفكير الوكلي، وتحديد الأسباب الجذرية للفشل، وتحويل هذه الرؤى إلى تحسينات ملموسة لوكلاء الذكاء الاصطناعي الموثوقين والمستعدين للمؤسسات.

لا تدع مجموعة البيانات التقييمية الخاصة بك تبقى خاملة. اختر وكيلك، اختر مجموعة البيانات الخاصة بك، وقم بتشغيل تقييم في العالم الحقيقي. كرر مع كل تشغيل - تتبع ما يعمل، حدد أين ينزلق الوكلاء، وحول كل فشل إلى حالة الاختبار التالية الخاصة بك.

هل أنت مستعد للانتقال من النظرية إلى التميز في الذكاء الاصطناعي للمؤسسات؟ قم بتشغيل تقييم الوكيل الأول الخاص بك اليوم، وابق على اطلاع على دليلنا التالي: "كيفية تحليل وتفسير واتخاذ الإجراءات بناءً على نتائج تقييم وكلاء الذكاء الاصطناعي - تحويل المقاييس إلى قيمة للأعمال"